KI-Compliance

Methodische EU AI Act Compliance für deutsche KMU. Ich begleite dich von der Bestandsaufnahme bis zum laufenden Monitoring.

Erstgespräch buchenZwei Pakete

Compliance, passend zu deiner Situation

Compliance ist kein Projekt, das man einmal abhakt. Je nach deiner Ausgangssituation brauchst du entweder einen schnellen Standortcheck oder ein vollständiges Audit. Beide Pakete bauen aufeinander auf und zahlen auf eine eigenständige Compliance-Pflege ein.

KI-Compliance-Check

Das bekommst du

Du weißt, wo du stehst. Eine erste Bestandsaufnahme deiner KI-Nutzung, eine Risikoeinschätzung und eine konkrete Prioritätenliste. Die Umsetzung liegt noch vor dir.

- 60-Min-Briefing-Gespräch zur Erfassung der Ausgangssituation

- Erfassung von 2-3 KI-Systemen in der NADOVO-Plattform

- Erste Risikoklassifizierung (Pflichtklassen nach EU AI Act)

- Schriftlicher Kompakt-Bericht mit aktueller Compliance-Situation

- Konkrete Handlungsempfehlungen für die nächsten Schritte

- 30 Tage Zugang zur NADOVO-Plattform

499 €

Pauschalpreis

Dauer: ca. 2 Wochen

Erstgespräch buchenKI-Compliance-Audit

Das bekommst du

Alles ist erledigt. Vollständige Dokumentation, KI-Richtlinie, Mitarbeiterschulung. Du musst nichts mehr selbst aufbauen, nur noch laufend pflegen.

- Strukturierte Schatten-KI-Aufdeckung über Workshop und Stakeholder-Interviews

- Vollständige Erfassung aller KI-Systeme in NADOVO

- Vollständige Risikoklassifizierung nach EU AI Act

- Compliance-Roadmap mit priorisierten Maßnahmen

- Pflichtdokumente nach Art. 26 EU AI Act vorbereitet

- Detaillierter Compliance-Audit-Bericht

- 90 Tage Zugang zur NADOVO-Plattform

- Coaching-Session zur eigenständigen Compliance-Pflege

Individuelles Angebot

Investition nach Erstgespräch

Dauer: ca. 4-6 Wochen

Erstgespräch buchenBrauchst du langfristige Begleitung?

Mit der KI-Compliance-Begleitung unterstütze ich dich individuell skalierbar bei der Roadmap-Umsetzung, regelmäßigen Reviews und Schulungen. Auf Anfrage und individuell vereinbart.

Kostenlose Ressource

EU AI Act Leitfaden

Der kompakte Leitfaden für deutsche KMU: Pflichten, Fristen, Klassifizierung und praktische Schritte zur Umsetzung. Direkt als PDF herunterladbar.

Leitfaden herunterladen (PDF)

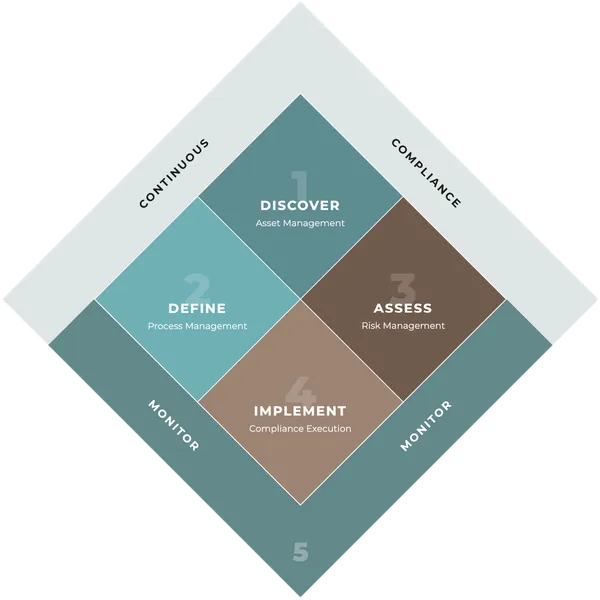

Mein Framework

KI-Compliance-Framework

-

DISCOVER - Was haben wir? KI-Assets erfassen, Rollen bestimmen (Provider/Deployer)

-

DEFINE - Wofür nutzen wir es? Asset + Anwendungsbereich = Prozess → Risikoklasse

-

ASSESS - Welche Risiken? HIGH-RISK Prozesse systematisch bewerten

-

IMPLEMENT - Wie setzen wir um? Maßnahmen, Schulungen, Dokumentation

-

MONITOR - Wie bleiben wir compliant? Laufende Überwachung, Incidents, Reassessment

Häufige Fragen

Antworten zur EU AI Act Compliance

Wer ist vom EU AI Act betroffen? +

Fast jedes Unternehmen, das KI-Systeme einsetzt oder entwickelt, fällt unter den EU AI Act. Die Verordnung unterscheidet vor allem zwei Rollen: Provider entwickeln KI-Systeme oder bringen sie unter eigenem Namen in Verkehr. Deployer nutzen fertige KI-Systeme in eigener Verantwortung für berufliche Zwecke. Die meisten KMU sind Deployer, etwa wenn sie Microsoft Copilot, ChatGPT oder branchenspezifische SaaS-Tools einsetzen.

Die Rolle wird pro KI-System bestimmt, nicht pro Unternehmen. Ein Unternehmen kann gleichzeitig Provider für ein selbst entwickeltes System und Deployer für zugekaufte Lösungen sein. Einen vertieften Überblick bietet mein EU AI Act Leitfaden (PDF).

Was sind Deployer-Pflichten nach Artikel 26? +

Für Betreiber von Hochrisiko-KI-Systemen definiert Artikel 26 einen konkreten Pflichtenkatalog. Dazu gehören die Nutzung gemäß Betriebsanleitung des Providers, die Sicherstellung menschlicher Aufsicht durch qualifiziertes Personal, die Kontrolle über Eingabedaten sowie die mindestens sechsmonatige Aufbewahrung automatisch erzeugter Logs.

Hinzu kommen laufende Überwachung, die Meldung schwerwiegender Vorfälle an Provider und Marktüberwachungsbehörde sowie Informationspflichten gegenüber betroffenen Arbeitnehmern, wenn das System am Arbeitsplatz eingesetzt wird. Öffentliche Stellen, Banken und Versicherungen müssen zusätzlich eine Grundrechte-Folgenabschätzung durchführen. Details im Artikel Deployer-Pflichten im EU AI Act.

Wie erkenne ich, ob mein KI-System als Hochrisiko eingestuft wird? +

Der EU AI Act klassifiziert nicht Tools, sondern Anwendungen. Entscheidend ist der konkrete Verwendungszweck, nicht das System selbst. Artikel 6 macht die Risikoklasse vom intended purpose abhängig. Dasselbe KI-Modell kann je nach Einsatzfeld minimal riskant oder hochriskant sein.

Hochrisiko liegt vor, wenn ein System in einen der acht Bereiche aus Annex III fällt: Biometrie, kritische Infrastruktur, Bildung, Beschäftigung und Personalmanagement, Zugang zu wesentlichen Dienstleistungen, Strafverfolgung, Migration und Asyl sowie Justiz und demokratische Prozesse. Für KMU sind vor allem HR-Anwendungen und Kreditwürdigkeitsprüfungen relevant. Führt das System Profiling natürlicher Personen durch, gilt es immer als hochriskant. Mehr dazu im Artikel Hochrisiko-KI erkennen.

Was ist das NADOVO-Framework? +

NADOVO ist mein 5-Phasen-Framework für EU AI Act Compliance: DISCOVER (KI-Assets erfassen und Rollen bestimmen), DEFINE (Assets mit Anwendungsfällen zu Prozessen verknüpfen und Risikoklassen bestimmen), ASSESS (systematische Risikobewertung für Hochrisiko-Prozesse), IMPLEMENT (Maßnahmen, Schulungen und Dokumentation umsetzen) und MONITOR (laufende Überwachung und Reassessment).

Der Clou ist der Prozess-Layer: Nicht das Tool wird klassifiziert, sondern die Kombination aus Asset und Anwendungsfall. So skaliert der Aufwand mit dem tatsächlichen Risiko statt pauschal für jedes Tool. Für die systematische Umsetzung nutze ich NADOVO zusätzlich als Software-Plattform, die das Framework technisch abbildet, Audit-Trails erzeugt und Risikoklassifizierungen dokumentiert. Überblick im Artikel Der NADOVO Compliance Cycle.

Ab wann gelten die EU-AI-Act-Regeln? +

Der EU AI Act tritt stufenweise in Kraft. Seit Februar 2025 gelten die Verbote unzulässiger KI-Praktiken und die Pflicht zur KI-Kompetenz nach Artikel 4. Seit August 2025 greifen die Regeln für General-Purpose-AI-Modelle. Am 2. August 2026 folgen die vollständigen Anforderungen für Hochrisiko-Systeme nach Annex III, das ist die entscheidende Deadline für die meisten Unternehmen.

Der im November 2025 vorgeschlagene Digital Omnibus könnte die Hochrisiko-Deadline auf Dezember 2027 verschieben, ist aber noch nicht beschlossen. Bis der Gesetzgebungsprozess abgeschlossen ist, bleibt August 2026 geltendes Recht. Mehr zur Unsicherheit im Artikel EU AI Act Deadline.

Brauche ich zwingend externe Beratung für EU-AI-Act-Compliance? +

Zwingend nicht, aber in den meisten Fällen sinnvoll. Der EU AI Act umfasst 180 Erwägungsgründe, 113 Artikel und 13 Anhänge mit unterschiedlichen Pflichten je nach Rolle und Risikoklasse. Die korrekte Klassifizierung eines KI-gestützten Bewerbermanagements, die Grundrechte-Folgenabschätzung für Hochrisiko-Systeme oder die Frage, wann ein Deployer ungewollt zum Provider wird, erfordern Fachkenntnis.

Was Beratung allein aber nicht löst: Compliance ist kein Zustand, sondern ein laufender Prozess. Artikel 12 verlangt eine zehnjährige Dokumentation jeder Änderung, Risikobewertung und Maßnahme. Excel-Listen und statische PDF-Berichte scheitern hier. Sinnvoll ist eine Kombination aus fachlicher Einordnung und strukturiertem Prozess, der Beratungsergebnisse operationalisiert. Details im Artikel KI-Compliance braucht Struktur.

Nächster Schritt

Bereit für ein Erstgespräch?

30 Minuten, kostenfrei. Im Gespräch klären wir gemeinsam, ob und wie ich dir helfen kann.

Erstgespräch buchen